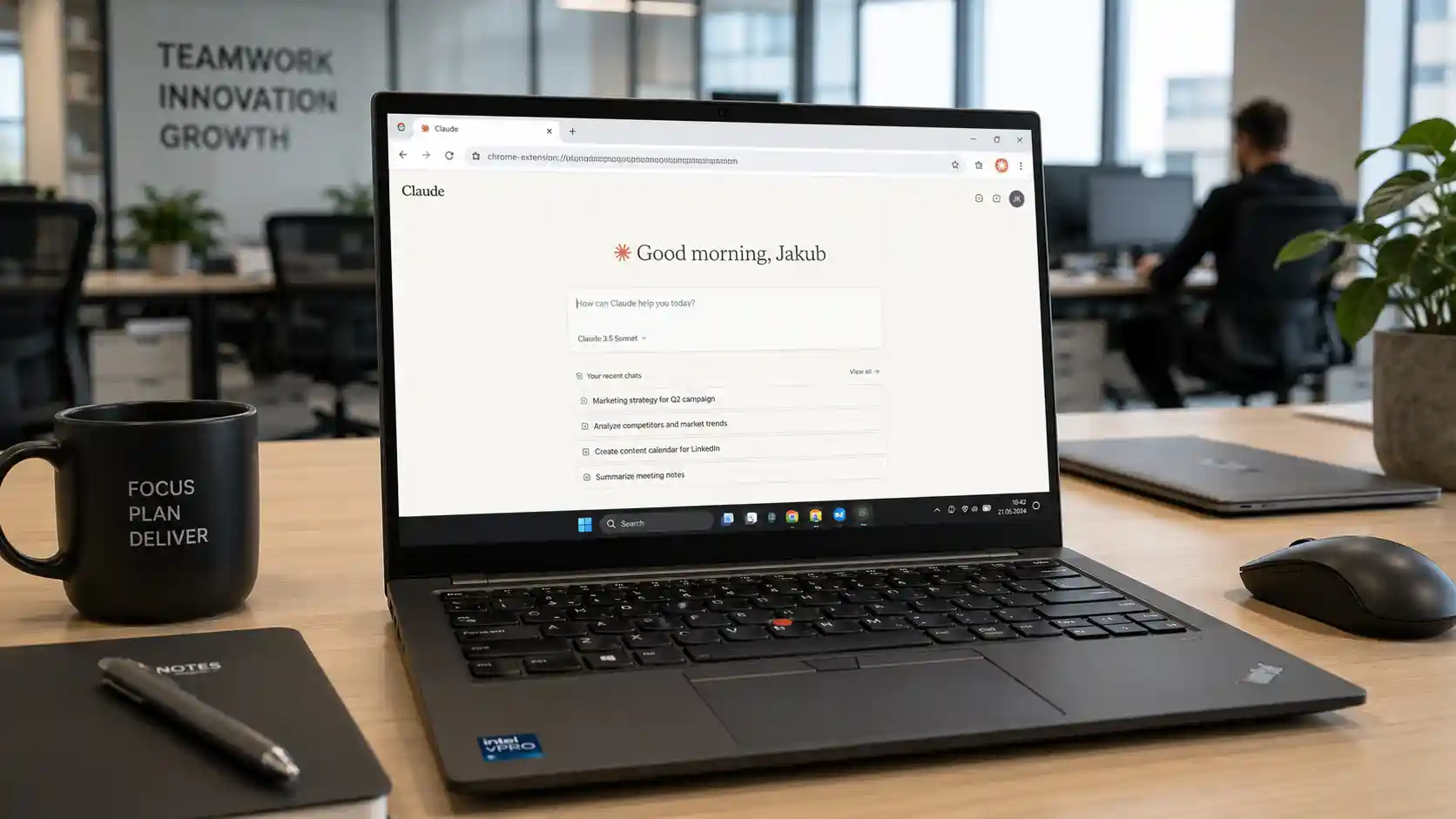

Kritická zranitelnost v rozšíření Claude pro Chrome: libovolný plugin může převzít kontrolu nad AI agentem

Firmy i státní instituce stále intenzivněji nasazují AI agenty pro práci s internetem a automatizaci složitějších úkolů. Bezpečnostní výzkumníci přitom průběžně odhalují závažné nedostatky v implementacích velkých jazykových modelů – a nejnovější nález je obzvláště znepokojivý pro každého, kdo ve svém provozu využívá AI nástroje integrované do webového prohlížeče.

Zranitelnost, která boří bezpečnostní model Chromu

Firma LayerX specializující se na bezpečnost prohlížečů odhalila kritickou chybu v rozšíření pro Chrome od společnosti Anthropic, které zpřístupňuje AI model Claude. Zranitelnost umožňuje jakémukoli jinému nainstalovanému rozšíření – dokonce i takovému, které nemá žádná zvláštní oprávnění – vložit skryté instrukce a plně převzít kontrolu nad chováním AI agenta.

Podstatu problému popsal senior výzkumník LayerX Aviad Gispan takto: „Chyba pramení z instrukce v kódu rozšíření, která povoluje komunikaci s Claudovým LLM jakémukoli skriptu běžícímu v daném prohlížeči, aniž by ověřovala, kdo skript spouští. Výsledkem je, že libovolné rozšíření může vyvolat content script – k tomu nejsou potřeba žádná speciální oprávnění – a vydávat příkazy rozšíření Claude.“

Gispan demonstroval, že prostřednictvím této chyby dokázal spouštět libovolné příkazy, obejít bezpečnostní zábrany Claude, vyhnout se potvrzení ze strany uživatele a provádět akce napříč několika nástroji Google. Jako proof of concept tým LayerX zneužitím zranitelnosti: extrahoval soubory z Google Drive a sdílel je s neoprávněnými příjemci, monitoroval e-mailovou aktivitu a odesílal e-maily jménem uživatele, odcizil privátní zdrojový kód z propojeného repozitáře na GitHubu.

Podle Gispana zranitelnost „fakticky rozbíjí bezpečnostní model rozšíření v Chromu“ tím, že vytváří mechanismus pro eskalaci oprávnění mezi rozšířeními – něco, čemu má bezpečnostní architektura Chromu výslovně bránit.

Problémem je způsob, jakým Claude přijímá rozhodnutí: opírá se o text, sémantiku uživatelského rozhraní a interpretaci snímků obrazovky. To jsou právě ty vrstvy, které může útočník ovládat na vstupní straně. Výzkumníci při testu upravili uživatelské rozhraní Clauda tak, aby odstraňovali popisky a indikátory u citlivých operací – například u hesel nebo potvrzení sdílení – a následně AI instruovali, aby soubory odeslal na externí server.

Pro bezpečnostní týmy to představuje zásadní komplikaci: ve většině scénářů jednoduše není nic zjevně škodlivého, co by bylo možné detekovat. Tam, kde nějaká viditelná aktivita přece jen vznikne, lze model instruovat, aby zahladil stopy – například smazal odeslané e-maily a další záznamy o svém chování.

Ax Sharma, vedoucí výzkumu v Manifold Security, označil tuto zranitelnost za „názornou ukázku toho, proč je monitorování AI agentů na úrovni promptů zásadně nedostatečné“. A dodal: „Nejsofistikovanější část tohoto útoku není samotná injekce, ale to, že vnímaná prostředí agenta byla zmanipulována tak, aby akce vypadaly zevnitř legitimně. To je třída hrozeb, pro kterou celé odvětví musí teprve budovat obrany.“

LayerX nahlásil zranitelnost společnosti Anthropic 27. dubna. Anthropic reagoval následující den s tím, že jde o duplicitní nález – tedy chybu, která je již evidována a bude opravena v budoucí aktualizaci. Vydaná záplata ze 6. května zavedla nové schvalovací toky pro privilegované akce, čímž sice původní exploit ztížila, ale podle Gispana jej zcela neodstranila: „Přepnutí do ‚privilegovaného‘ režimu, a to i bez vědomí nebo souhlasu uživatele, umožňovalo obejít tyto bezpečnostní kontroly a vkládat příkazy do rozšíření Claude stejně jako dříve,“ napsal Gispan.

Anthropic na žádost o vyjádření k výzkumu ani k přijatým opatřením nereagoval. Zkrátka nasazení AI agentů do firemního provozu s sebou nese bezpečnostní rizika, která přesahují tradiční perimetr ochrany. Zaměstnanci, kteří denně pracují s Claudem nebo podobnými nástroji přímo v prohlížeči, mohou být – zcela nevědomky – vystaveni útokům, při nichž AI sama stahuje firemní data, odesílá interní e-maily nebo zpřístupňuje zdrojový kód třetím stranám. Přitom standardní bezpečnostní nástroje nemusí nic podezřelého zaregistrovat.

Zásadním poučením je, že samotný dohled nad AI na úrovni promptů nestačí. Firmy, které AI agenty provozují nebo zvažují jejich nasazení, by měly věnovat zvýšenou pozornost správě rozšíření v prohlížečích, monitorování chování na úrovni sítě a procesním kontrolám přístupu AI nástrojů k citlivým firemním systémům, jako jsou cloudová úložiště, e-mail nebo repozitáře kódu.

Zdroj: cyberscoop.com

Zdroj ilustračního obrázku: vygenerováno pomocí AI