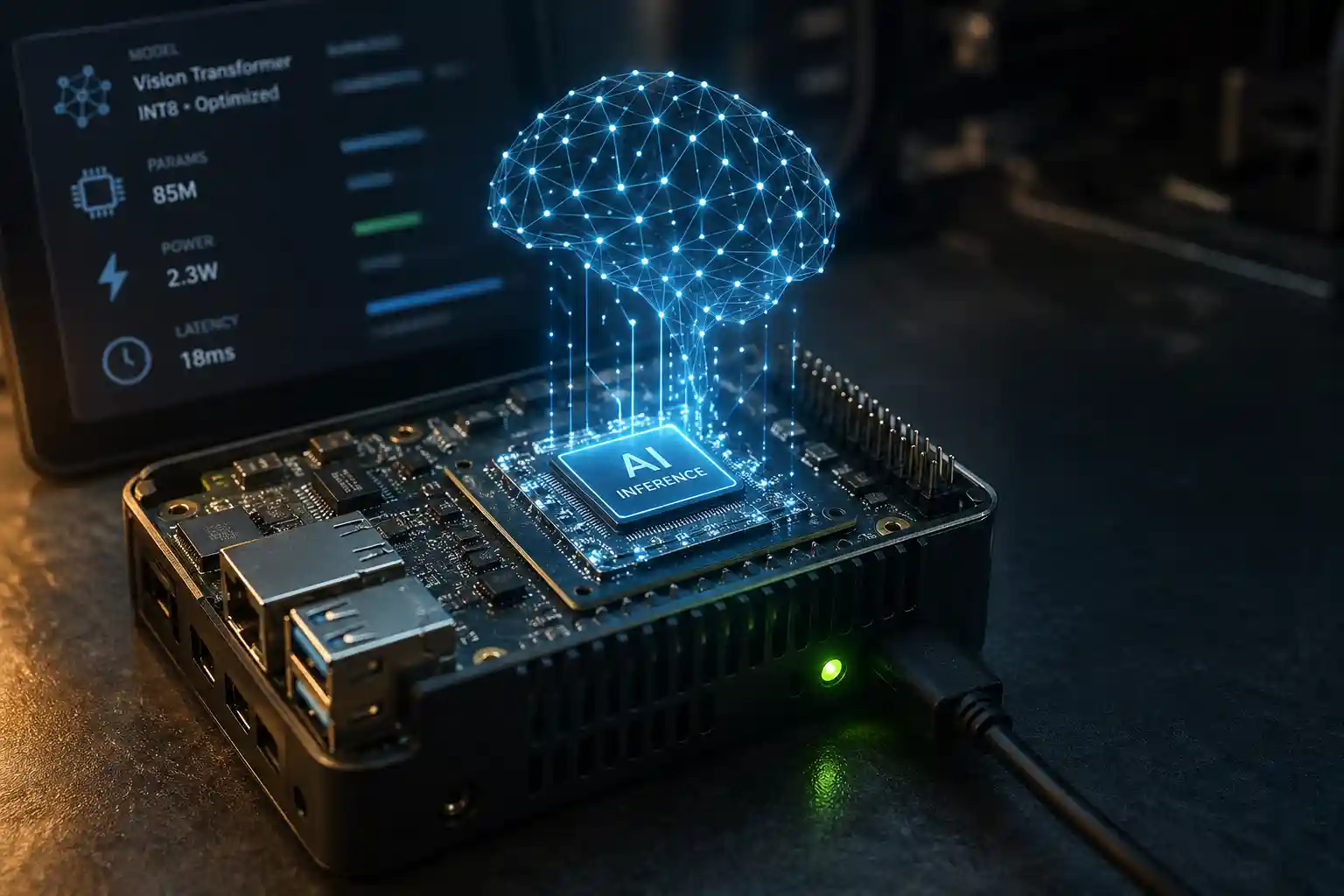

Nasazení výkonnějších a přesnějších AI modelů i na zařízeních s omezenými hardwarovými prostředky

Výzkumníci z Massachusetts Institute of Technology (MIT) vyvinuli metodu, která dokáže zrychlit trénování AI modelů metodou federovaného učení o přibližně 81 procent.

Tento průlom otevírá cestu k nasazení výkonnějších a přesnějších AI modelů i na zařízeních s omezenými hardwarovými prostředky – tedy na senzorech, chytrých hodinkách nebo starších mobilních telefonech – a to při zachování plné ochrany uživatelských dat.

Například ve zdravotnictví, finančních službách nebo průmyslové automatizaci – jde o výsledek, který stojí za pozornost.

Co je federované učení a proč na něm záleží

Federované učení (federated learning) je přístup, při němž centrální server rozešle AI model do sítě koncových zařízení. Každé zařízení model dotrénuje na svých lokálních datech a pošle zpět pouze aktualizace vah modelu – nikoliv samotná data. Uživatelská data tak nikdy neopustí dané zařízení, což je klíčová vlastnost pro aplikace vyžadující soulad s předpisy o ochraně osobních údajů, jako je GDPR. Problém nastává v heterogenních sítích, kde mají různá zařízení různou výpočetní kapacitu, paměť a kvalitu síťového připojení.

Tradiční přístupy k federovanému učení předpokládají, že všechna zařízení v síti zvládnou uložit, natrénovat a přenést celý model v rozumném čase. Ve skutečnosti ale server čeká na odpovědi od všech zařízení, průměruje přijaté aktualizace a teprve pak pokračuje do dalšího trénovacího kola. Pomalá nebo slabá zařízení tak brzdí celou síť – a v krajním případě mohou trénování zcela zablokovat.

Tři klíčové inovace frameworku FTTE

Výzkumný tým vytvořil framework s názvem FTTE (Federated Tiny Training Engine), jehož cílem je radikálně snížit nároky na paměť i objem přenášených dat u každého zařízení v síti. Framework stojí na třech vzájemně se doplňujících principech.

Zaprvé, server nerozesílá celý model, ale pouze vybranou podmnožinu parametrů – interních proměnných, které se během trénování upravují. FTTE využívá speciální vyhledávací proceduru, která identifikuje tu sadu parametrů, jež maximalizuje přesnost modelu při dodržení stanoveného paměťového limitu. Tento limit vychází z možností nejslabšího zařízení v síti.

Zadruhé, server pracuje asynchronně. Namísto čekání na odpovědi od všech zařízení průběžně shromažďuje příchozí aktualizace a jakmile dosáhne předem stanovené kapacity, zahájí další trénovací kolo. Výkonné přístroje tak nemusí nečinně čekat na ta pomalá.

Zatřetí, server přiřazuje jednotlivým aktualizacím váhu podle toho, kdy je obdržel. Starší aktualizace mají na výsledný model menší vliv. Tím se eliminuje negativní dopad zastaralých dat, která by jinak zpomalovala konvergenci modelu nebo snižovala jeho přesnost.

„Používáme tento semi-asynchronní přístup, protože chceme do trénování zapojit i nejslabší zařízení – aby mohla přispět svými daty – ale zároveň nechceme, aby výkonnější zařízení zbytečně čekala a plýtvala prostředky,“ vysvětluje Irene Tenison, doktorandka na katedře elektrotechniky a informatiky MIT a hlavní autorka výzkumu.

Výsledky: 81 % zrychlení, 80 % úspora paměti

Výzkumníci testovali FTTE v simulacích zahrnujících stovky heterogenních zařízení s různými modely a datovými sadami. Výsledky jsou přesvědčivé: trénování bylo v průměru dokončeno o 81 procent rychleji než při použití standardních přístupů k federovanému učení. Paměťové nároky na jednotlivých zařízeních klesly o 80 procen* a objem přenášených dat se snížil o 69 procent – při zachování přesnosti srovnatelné s konkurenčními metodami.

Jisté snížení přesnosti modelu oproti plnohodnotnému federovanému učení existuje, ale Tenison ho považuje za přijatelný kompromis: „Chceme, aby model trénoval co nejrychleji a šetřil baterii těchto zařízení. Mírný pokles přesnosti může být v řadě aplikací akceptovatelný, zvláště když naše metoda pracuje tak výrazně rychleji.“

FTTE navíc prokázalo dobrou škálovatelnost – s rostoucím počtem zařízení v síti se výkonnostní přínosy dále zvyšují. Kromě simulací byl framework ověřen také na reálné síti fyzických zařízení s různou výpočetní silou.

Praktický dopad pro podnikové IT

Výsledky výzkumu budou prezentovány na konferenci IEEE International Joint Conference on Neural Networks. Na projektu spolupracovali Anna Murphy z Lincoln Laboratory, Charles Beauville z École Polytechnique Fédérale de Lausanne (EPFL) a Flower Labs, a vedoucí výzkumnice Lalana Kagal z MIT CSAIL. Projekt byl částečně financován stipendiem Takeda PhD Fellowship.

Prorganizace nasazující IoT senzory ve výrobě, nositelná zařízení v nemocnicích nebo mobilní aplikace ve finančních službách má FTTE přímý praktický přesah: umožňuje trénovat a zlepšovat AI modely přímo na hraně sítě bez nutnosti odesílat citlivá data do cloudu. To zjednodušuje soulad s regulatorními požadavky a snižuje závislost na výkonné síťové infrastruktuře.

„Jde o to, přinést AI na malá zařízení, kde dosud nebylo možné podobně výkonné modely provozovat. Tato zařízení nosíme každý den u sebe. AI musí být schopna běžet na nich – nejen na obřích serverech a GPU,“ shrnuje Tenison.

Do budoucna plánují výzkumníci zaměřit se na personalizaci AI modelů pro jednotlivá zařízení namísto optimalizace průměrného výkonu napříč celou sítí, a dále rozšířit experimenty na větší sestavy reálného hardwaru.

Zdroj: news.mit.edu