Shadow AI: Neautorizované využívání gen-AI představuje pro podniky riziko

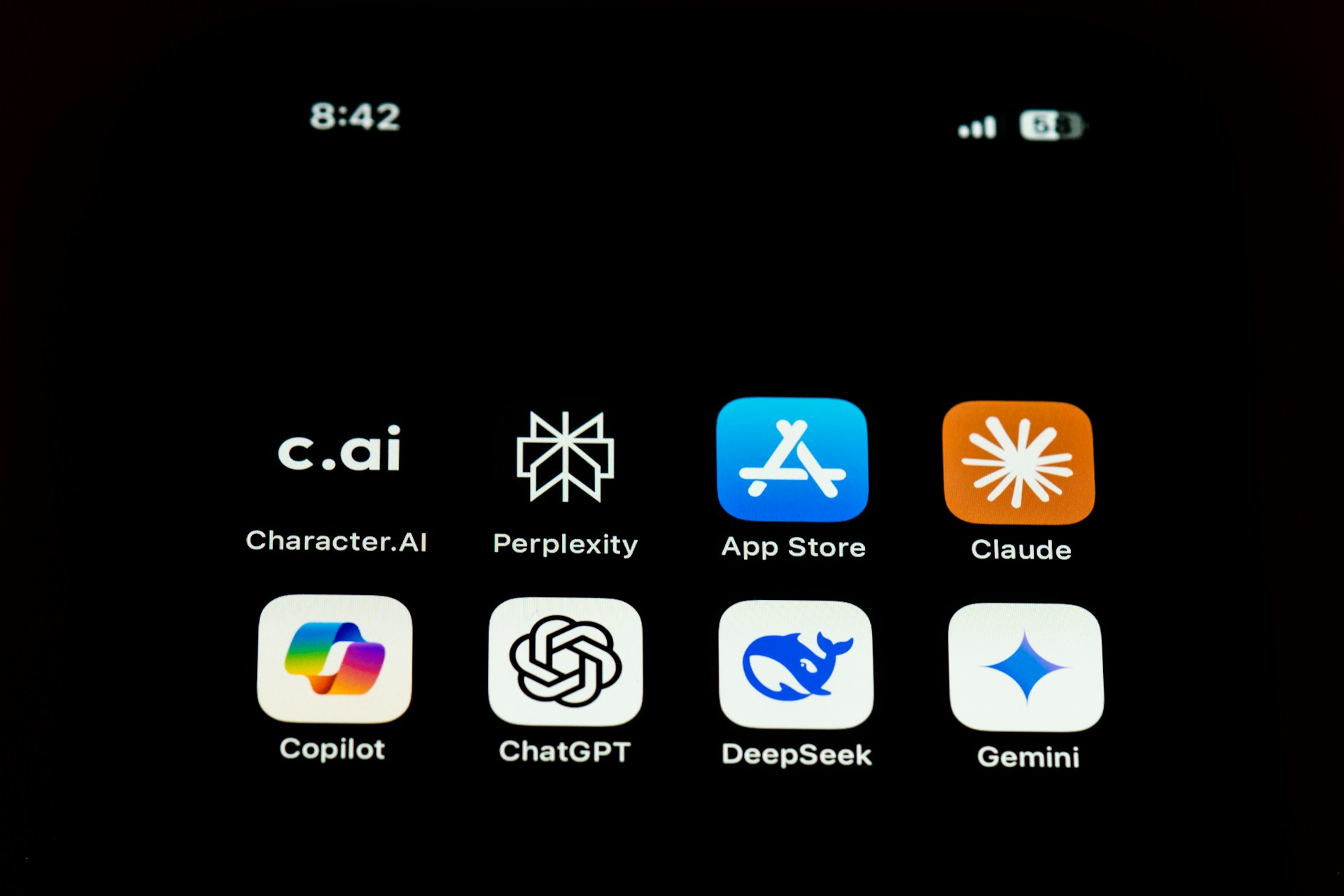

Podle nové zprávy Enterprise GenAI Data Security Report 2025, kterou zveřejnila společnost LayerX, dochází k masivnímu neautorizovanému využívání generativní umělé inteligence (gen-AI) v podnicích. Až 89 % interakcí se systémy gen-AI probíhá mimo dohled IT oddělení, což vystavuje organizace vážným bezpečnostním hrozbám, jako jsou úniky citlivých dat a neoprávněný přístup.

Gen-AI v podnicích: mírný rozjezd, ale rychlá akcelerace

Navzdory mediálnímu humbuku zatím pouze 15 % zaměstnanců používá gen-AI denně, ale trend se rychle zrychluje. Každý druhý zaměstnanec využívá gen-AI alespoň jednou za dva týdny, přičemž nejčastějšími uživateli jsou vývojáři softwaru (39 %). To přináší zásadní riziko úniku zdrojového kódu a neúmyslného začlenění nebezpečného kódu do firemních aplikací.

„Shadow AI“: Skrytá hrozba pro firemní data

Většina zaměstnanců používá gen-AI z osobních účtů (72 %), což znamená, že IT oddělení nemá žádnou kontrolu nad sdílením firemních informací. Jen 12 % přístupů probíhá přes firemní účty se SSO autentizací, což dává útočníkům příležitost k zneužití přihlašovacích údajů a cíleným phishingovým útokům.

Polovina vkládaných dat obsahuje citlivé informace

Nejnebezpečnějším zjištěním je, že 50 % obsahu vkládaného do gen-AI aplikací obsahuje firemní data. Zaměstnanci do těchto systémů kopírují informace v průměru 4× denně, a to včetně finančních plánů, zákaznických údajů a zdrojového kódu. Jakmile jsou tato data odeslána do AI modelů, jejich smazání nebo kontrola je prakticky nemožná.

Co by měly podniky udělat hned teď?

Tradiční bezpečnostní nástroje nejsou na tento problém připraveny – většina gen-AI aplikací je prohlížečová (SaaS) a obchází běžné DLP (Data Loss Prevention) ochrany. Firmy by měly okamžitě:

- Získat viditelnost nad AI aplikacemi – Monitorovat nejen schválené, ale i „Shadow AI“ aplikace.

- Zavést DLP ochranu pro prohlížeče – Detekovat a řídit interakce s gen-AI na úrovni prohlížeče.

- Vynucovat bezpečné přihlašování – Používat SSO autentizaci a omezení přístupu k neautorizovaným AI nástrojům.

- Školit zaměstnance o rizicích – Uvědomit uživatele o nevratnosti sdílených dat s AI nástroji.

Gen-AI je budoucnost, ale i riziko

Generativní AI se stává běžnou součástí pracovního procesu, ale její neřízené používání může mít fatální důsledky pro bezpečnost dat. Firmy, které situaci podcení, se mohou stát obětí úniků citlivých informací, regulatorních pokut a poškození reputace. Viditelnost, kontrola a prevence musí být v roce 2025 klíčovými pilíři bezpečnostní strategie pro gen-AI.

Zdroj: thehackernews.com

Zdroj ilustračního obrázku: Saradasish Pradhan on Unsplash